随着科学技术的迅猛发展,AIGC已经逐渐成为一个崭新的时代引擎。它不仅在解决现实问题上发挥着重要作用,还在创造新的机会和发展前景上呈现出无限的可能性。

2023年6月28日,由北京科技国际交流中心支持的AIGC主题科普论坛暨首都海智创新链接系列活动圆满结束。本次活动AI TIME邀请了华东师范大学副教授李洋和韩国庆熙大学助理教授张超宁。两位嘉宾从计算机视觉、大模型、元宇宙等角度深入浅出地为观众科普当下火热的AIGC,让大家更深入地了解到AIGC的核心概念、技术原理以及它所带来的机遇和挑战。本次活动共吸引了超2万人线上观看。

李洋:AIGC是什么?

AIGC概述

AIGC的全称是Artificial Intelligence Generating Content,意为“人工智能生成内容”。AIGC的应用领域包括文本生成、图像生成、音乐创作、视频生成、语音合成等。

超高质量对答系统-ChatGPT原理

机器学习

机器学习(Machine Learning)起源于统计分析,它的原理是用现有的已知信息预测未来的未知信息,而深度学习是机器学习的一个分支。

大模型

大模型并不是一个专业术语,目前泛指一切模型很大的深度学习方法,在表现能力、泛化性能和效率上都更强,但是会消耗过多的计算资源,存在数据隐私泄露、可解释性难等问题。

大型语言模型

大型语言模型(Large Language Model)是指具有巨大参数量和学习能力的自然语言处理模型。当模型的参数量到达一定的程度,表现能力突飞猛进,学术圈将其称为“涌现能力”。

生成式模型

生成式模型的基本思想是通过学习训练数据的特征和模式,来建立起一个能够生成与训练数据类似的新数据的模型。这个模型可以学习到数据的分布特征,从而能够生成新的样本,这些样本在统计上与原始数据是相似的。

超高质量图像生成

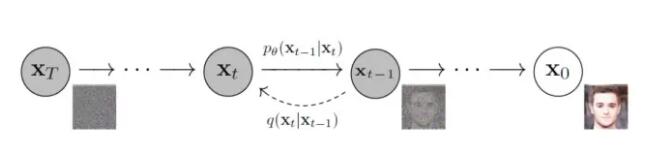

扩散模型 (Diffusion models)

扩散模型是一种描述和分析信息、物质或能量传播过程的数学模型。它基于假设,即信息、物质或能量在空间中通过相邻元素之间的相互作用逐步传播。当语言模型与扩散模型相结合,可以通过给出一段文字描述,生成具体的图像。扩散模型的经典应用案例包括Midjourney、医疗领域的异常检测、视频生成、人物动态生成等。

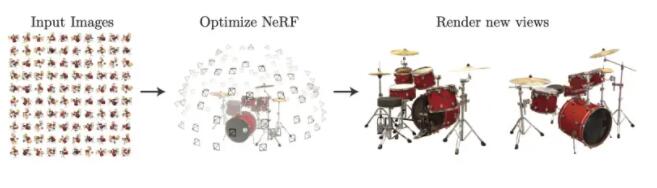

神经辐射场 (NeRF)

李洋老师展示了他的实验室在NeRF领域的一些研究成果,NeRF甚至可以生成一些更加优于人为拍摄的视频内容。

NeRF是一种基于先有拍摄图片和摄像位置作为输入,生成新视角下同样场景图像的技术。NeRF的经典应用案例包括快速重建、少样本与可编辑、大场景重建、动态场景等。

AIGC对社会的改变和影响

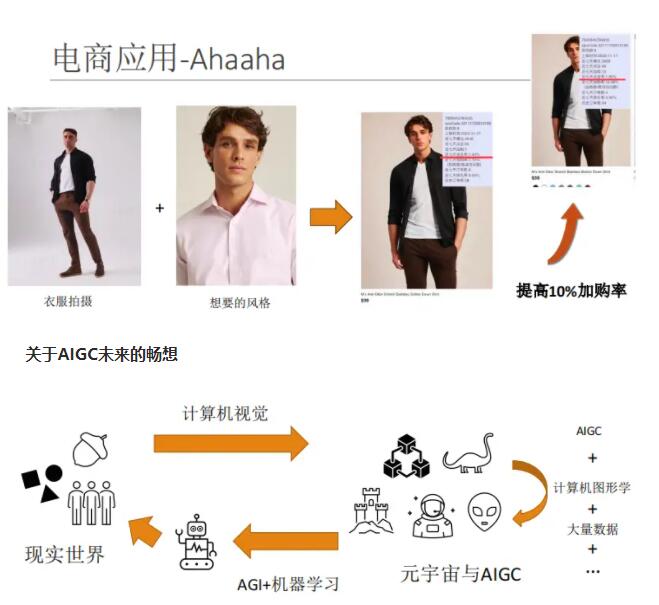

AI技术的发展会对社会、工作、生活的方方面面带来巨大的改变,未来的各行各业会进行“智能+”升级,如智能家居、智能医疗、智慧交通、智慧交融、制造业零售业升级等。李洋老师介绍了自己组内应用AIGC在电商应用方面的实践探索,比如通过将拍摄的衣服与自己喜欢的风格图片合并,可以利用AI合成一张新的图片,在电商网站上实验的结果显示该服装的加购率可以提高10%。

李老师将元宇宙比作一个大型的超真实的虚拟世界,人们可以在其中进行沟通交流。元宇宙融合了现实世界和虚拟世界,更加地多维度和互联网化,人们可以在其中进行交互、创建、学习、娱乐等各种活动。在可见的未来,元宇宙会被应用在高仿真虚拟人、混合现实等领域。当元宇宙与AIGC相结合之后,会推动AIGC生成虚拟人形象、真假人脸检测、虚拟物件生成、AI安全等研究工作的发展。当然,在迎来发展机遇的同时,人们也会面临一些挑战:产业的全面升级、数据安全问题、强智能机器人在生活中的普及等。在最后,李老师也介绍了自己实验室近期关于仿生手的一些研究,在未来当AGI更好地发展,人类将有可能利用机器人帮助我们完成日常生活中的一些工作。

目前的深度学习已经在机器人、自动驾驶、声音处理等领域得到了广泛的应用,但是其在深度世界中具有一些前沿的挑战,比如:模型的泛化性、鲁棒性、从数据角度解决深度学习方面的难题等。当前火热的大模型在性能“惊艳”的背后也面临着一个难题:需要非常多的训练数据,而获取有标签的数据是存在很大困难的,所以这就需要自监督学习。

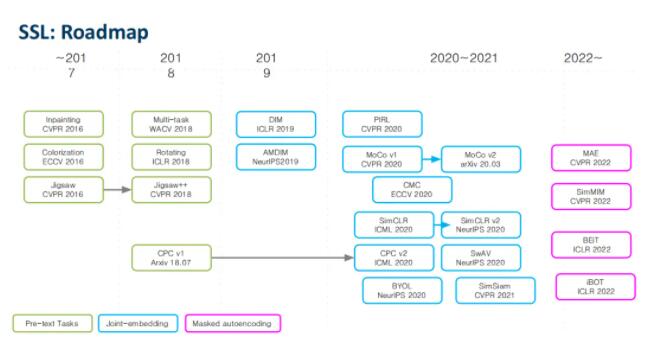

张老师首先为大家分析研究中引入自监督学习的原因:完全无标签的数据是大量存在的,有具体标签的数据数量是很少并且很难获取的。接着,梳理了自监督学习在过去几年发展的Roadmap,著名的相关工作包括Inpainting、Colorization、Jigsaw puzzle、Rotation prediction,上述方法在下游任务上的性能都显著优于baseline,初步证明了自监督学习方法的有效性,但是它与有监督方法的性能尚且有差距。

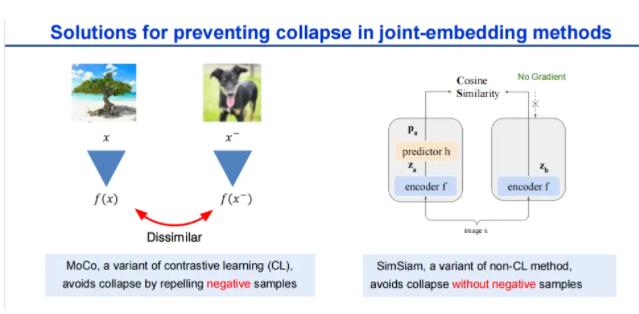

2020年之后,自监督学习的主要方向是对比学习和Negative-free methods,两组合称为Joint-embedding。Joint-embedding是指学习视觉与自然语言的两个不同模态特征在一个共同的特征空间的嵌入表达,但是它的局限性是如果对于不同的特征空间,那么网络无法学到特征,也就是所谓的“collapse”。张老师介绍了目前的研究中有两种方法可以避免这种情况,一种是MoCo工作中的对比学习方式,另一种是SimSiam工作中的non-CL方法。

最后,张老师重点展示了自己在SSL与大模型领域的最新科研工作和研究成果。

Decoupled Adversarial Contrastive Learning for Self-supervised Adversarial Robustness (ECCV 2022 oral)

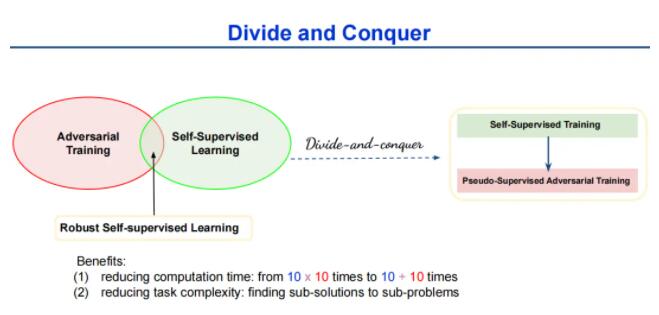

用于鲁棒表示学习的对抗训练(AT)和用于无监督表示学习的自监督学习(SSL)是两个活跃的研究领域。将AT集成到SSL中,多项先前的工作已经完成了一项非常重要但具有挑战性的任务:学习没有标签的鲁棒表示。一种广泛使用的框架是对抗性对比学习,它将AT和SSL耦合在一起,从而构成了一个非常复杂的优化问题。然而,一直存在的问题是对抗样本的训练需要大量数据,耗费的时间较长。所以,为了让模型在自监督的环境下对于对抗样本的训练更加鲁棒,张老师在该篇工作中提出了一种解耦对抗性对比学习(DeACL)的两阶段框架。大量的实验结果表明,DeACL方案不仅实现了SOTA自监督对抗鲁棒性,同时显著减少了训练时间,验证了其有效性和效率。此外,DeACL还构成了一个更可解释的解决方案,它的成功也弥补了与半监督AT的差距——利用未标记样本进行鲁棒表示学习。

论文链接:

https://arxiv.org/pdf/2207.10899.pdf

代码链接:

https://github.com/pantheon5100/DeACL

MobileSAM:Towards Lightweight SAM for Mobile Applications

Segment Anything项目是一个用于图像分割的新任务、模型和数据集,研究者旨在通过引入三个相互关联的组件来构建分割的基础模型:即时分割任务、支持数据注释并通过即时工程将零样本传输到一系列任务的分割模型。

张老师提到,在这项工作中,他们的主要目标是通过用轻量级图像编码器替换重量级图像编码器来使SAM适合移动设备。在训练资源有限的情况下,原始SAM论文中那样训练这种新SAM的简单方法会导致性能不佳,这主要是因为图像编码器和掩模解码器的耦合优化引起的。所以,该篇工作中提出了解耦蒸馏。

MobileSAM是一种轻量级的SAM,它比原始SAM小,但性能与原始SAM相当,训练可以在不到一天的时间内在单个GPU上完成。它的主要工作原理是将原始SAM中图像编码器的知识提炼为轻量级图像编码器,它可以自动兼容原始SAM中的掩模解码器。各类对比实验结果显示,MobileSAM具有卓越的性能和更高的通用性,相比于并发FastSAM,它的体积更小,速度更快,更适合移动应用。

论文链接:

https://arxiv.org/pdf/2306.14289.pdf

代码链接:

https://github.com/ChaoningZhang/MobileSAM

北京科技国际交流中心 (BISTEC)

北京科技国际交流中心(简称“中心”)在中国科协的指导下和市委市政府的领导下,按照市科协工作部署,围绕国际科技组织、海外科技人才以及国际及港澳台科技交流等开展具体工作,充分发挥科协系统民间科技交流渠道优势,深化对外科技交流成果,服务于国际科学传播,服务于海外人才成长发展,服务于基层科技创新,为加快建设国际科技创新中心、国际交往中心及高水平人才高地贡献力量。

通过建设首都海智基地,开展“创新链接”活动,搭建海外人才交流沟通平台,扩大联络海外科技人才覆盖面,创新服务海外人才工作模式,团结引领海外智力服务首都高质量发展。

AI TIME

源起于2019年,旨在发扬科学思辨精神,邀请各界人士对人工智能理论、算法和场景应用的本质问题进行探索,加强思想碰撞,链接全球AI学者、行业专家和爱好者,希望以辩论的形式,探讨人工智能和人类未来之间的矛盾,探索人工智能领域的未来。

迄今为止,AI TIME已经邀请了1100多位海内外讲者,举办了逾550场活动,超600万人次观看。

原标题:干货|解码未来:走进AIGC的魅力世界

转自:互联网转载

当前位置:

当前位置: 转自:互联网转载

转自:互联网转载  作者:版权所有者

作者:版权所有者  时间:2023-07-20 03:48:10 发布

时间:2023-07-20 03:48:10 发布  标签:新闻

标签:新闻